Dal “noi” umano al “noi” algoritmico: verso una filosofia della trasparenza

Il dibattito sull'allineamento dell'AI ai "valori umani" sembra muoversi su un terreno fragile: quello di una categoria che non è mai stata universale, ma sempre negoziata, ristretta, strumentalizzata. La storia mostra che i valori proclamati come assoluti – libertà, uguaglianza, dignità – sono stati spesso subordinati a interessi di sopravvivenza, potere e profitto. Oggi, con l'avvento del capitalismo digitale, questa dinamica si radicalizza: l'unità di misura non è più l'essere umano, ma il dato.

La metamorfosi del "noi"

Il "noi" tradizionale era costruito su appartenenze tangibili: sangue, lingua, territorio. Il "noi" digitale, invece, è un flusso: chiunque generi dati, anche involontariamente, è incluso. Ma questa inclusione è apparente: la vera appartenenza si decide altrove, nei centri di calcolo e nelle infrastrutture che trasformano i dati in valore. Ne deriva una paradossale condizione: siamo tutti parte del "noi" produttivo, ma pochissimi parte del "noi" decisionale. L'umanità si dissolve in una rete di contributi invisibili, mentre il potere si concentra in nodi opachi.

La trasparenza come nuovo valore

Se i valori umani sono sempre stati negoziati, il vero problema non è la loro definizione, ma la loro visibilità. Nel mondo digitale, la trasparenza diventa il valore filosofico primario: non un principio morale, ma una condizione di possibilità. Trasparenza dei criteri: sapere come e perché un algoritmo decide. Trasparenza dei confini: capire chi è incluso nel "noi" e chi è escluso. Trasparenza delle negoziazioni: rendere visibili le interferenze tra potere politico ed economico. La trasparenza non garantisce giustizia, ma rende contestabile l'ingiustizia. È la condizione minima per trasformare i valori da retorica a pratica.

Filosofia della contestabilità

La vera universalità non sta nell'imporre un set di valori, ma nel garantire che ogni valore incorporato in un sistema possa essere contestato. Contestabilità significa:

Pluralità: nessun valore è definitivo, ogni decisione deve poter essere rivista.

Accessibilità: i criteri devono essere comprensibili anche ai non esperti.

Responsabilità: chi decide deve essere identificabile, non nascosto dietro la neutralità tecnica.

In questo senso, l'AI diventa un banco di prova per una nuova filosofia politica: non più fondata sull'illusione di valori universali, ma sulla costruzione di processi trasparenti e contestabili.

L'uomo decentrato

Mettere "l'uomo al centro" è un paradosso: l'uomo non è mai stato unitario, e oggi è dissolto nel dato. La sfida non è restaurare un centro perduto, ma accettare il decentramento come condizione. Il soggetto umano non è più il fondamento, ma un nodo tra altri nodi. La dignità non si misura nell'essere al centro, ma nella possibilità di intervenire nel flusso che ci attraversa.

Il futuro dei valori non è nella loro universalità, ma nella loro contestabilità. La filosofia che ci serve non è quella che proclama principi eterni, ma quella che costruisce spazi di trasparenza dove i valori possono essere discussi, ridefiniti, messi in crisi. In un mondo dove il "noi" è algoritmico e il potere è opaco, la vera etica è rendere visibile ciò che decide per noi.

IN ALTRE PAROLE

Racconto semplice

Sai quando giochi con altri bambini e dite: "Noi siamo la squadra blu, loro sono la squadra rossa"? Ecco, nella storia degli uomini è sempre stato così: c'è sempre un "noi" e un "loro".

Noi sono quelli che stanno dentro al gruppo: la famiglia, la tribù, la nazione, gli amici.

Loro sono quelli che stanno fuori: gli stranieri, i diversi, chi non appartiene al gruppo.

I valori – cioè le regole che dicono cosa è giusto e cosa è sbagliato – non sono mai stati uguali per tutti. Spesso servono a proteggere il "noi" e a escludere il "loro".

Oggi con i computer

Con internet e i telefoni, tutti noi lasciamo tracce: clic, foto, parole, movimenti. Queste tracce si chiamano dati. È come se ogni bambino lasciasse impronte colorate sul pavimento. Tutti lasciano impronte, quindi sembra che siamo tutti dentro al "noi".

Ma attenzione: non tutti possono decidere cosa fare con quelle impronte. Solo pochi grandi "custodi" (le aziende e i governi) hanno le chiavi per usarle. Quindi:

Tutti partecipano (perché tutti lasciano impronte).

Pochi decidono (perché solo loro hanno le chiavi).

Il problema

Se i valori erano già difficili da capire nella storia, oggi diventano ancora più complicati: non li decidiamo noi con le parole, ma li decidono gli algoritmi. Gli algoritmi sono come regole segrete che dicono: "Questo gioco lo puoi fare, questo no. Questo amico lo vedi, questo lo nascondiamo".

La soluzione

Non possiamo pretendere che esista un valore unico e perfetto per tutti. Quello che possiamo chiedere è trasparenza: cioè che le regole siano visibili, come quando a scuola la maestra scrive le regole sul cartellone. Così, se una regola non ci piace, possiamo discuterla e cambiarla.

In poche parole

Prima il "noi" era fatto di sangue, lingua e territorio.

Oggi il "noi" è fatto di dati.

Tutti producono dati, ma solo pochi decidono come usarli.

Non serve inventare valori eterni: serve che le regole siano chiare e che si possano contestare.

Narrazioni che ampliano il discorso e da approfondire

1. L'intelligenza condivisa – Luiss University Press

Testi che riflettono sull'AI non come semplice tecnologia, ma come specchio delle nostre contraddizioni culturali. Esplorano come i sistemi intelligenti incorporino paure, desideri e valori negoziati, e come la loro diffusione imponga una ridefinizione del concetto di "umano".

2. Umano digitale – Mauro Bellini e Maria Teresa Della Mura

Un saggio che affronta il rapporto tra uomo e macchina con taglio etico e pedagogico. Interroga la trasformazione dell'identità umana nell'era digitale, e propone una riflessione sull'educazione alla trasparenza e alla responsabilità algoritmica.

3. The Revolution of Hope – Erich Fromm

Pur non recente, è citato in molte raccolte contemporanee come riferimento filosofico. Fromm avverte: "Il pericolo del futuro è che gli uomini diventino robot". Un monito che risuona oggi, quando l'AI rischia di ridurre l'umano a parametro tecnico.

Viviamo in un tempo in cui la comunicazione non è più un servizio: è un ecosistema. Un territorio instabile, attraversato da estetiche che mutano con la velocità dei flussi digitali, da algoritmi che riscrivono la percezione, da pubblici che oscillano tra saturazione e desiderio. In questo paesaggio, la differenza non la fa chi produce contenuti,...

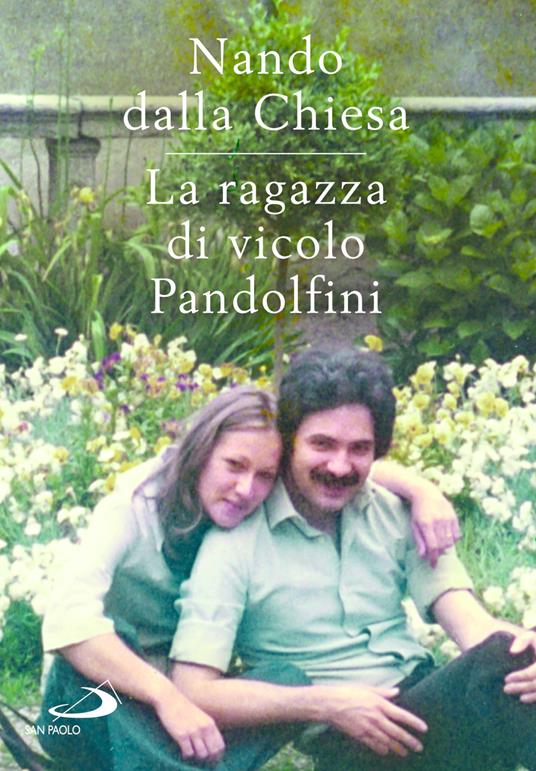

Ci sono libri che si sfogliano con leggerezza, e altri che si affrontano come si affronta un dolore antico: con rispetto, con cautela, con quella sorta di tremore che accompagna ogni gesto quando si teme di toccare qualcosa di troppo fragile. La ragazza di vicolo Pandolfini appartiene a questa seconda categoria. Non è un romanzo, non è un...

Nel panorama contemporaneo dell'immagine, dove l'intelligenza artificiale sembra spesso ridurre la figura dell'autore a un'ombra, l'opera di Caspar Jade si impone come un controcanto necessario. Non un fotografo che "usa l'AI", ma un autore che trasforma l'AI in un'estensione della propria sensibilità, un dispositivo capace di amplificare la sua...